Cette table ronde analyse comment les algorithmes perpétuent les stéréotypes, reproduisent et renforcent les discriminations. Comment les rendre plus équitables ? Elle est précédée d’une lecture-performance d’An Mertens.

Lecture-performance : Naive Bayes raconte

An Mertens expérimente des formes qui dévoilent la personnalité des algorithmes. Pour cette nouvelle création, elle se glisse dans la peau du “classifieur naïf bayésien”, un algorithme très utilisé pour trier les spams de nos boîtes aux lettres, pour analyser les sentiments sur les médias sociaux, mais aussi pour définir si un texte est écrit par une femme ou un homme.

Cette performance dévoile un aperçu de la façon dont cet algorithme lit les données, transforme les mots en nombres, fait des calculs qui définissent des motifs et est capable de prédire le sexe de l'auteur·e. Il révèle également ses limites, et comment il peut être trompé.

An Mertens propose d'adopter la perspective de la machine pour tenter de comprendre ce que signifie une prédiction selon laquelle une phrase a "78% de chance d'avoir été écrite par une femme".

An Mertens

Autrice et artiste, membre du collectif bruxellois Constant, elle s’intéresse à la manière dont les algorithmes transforment la création (littéraire).

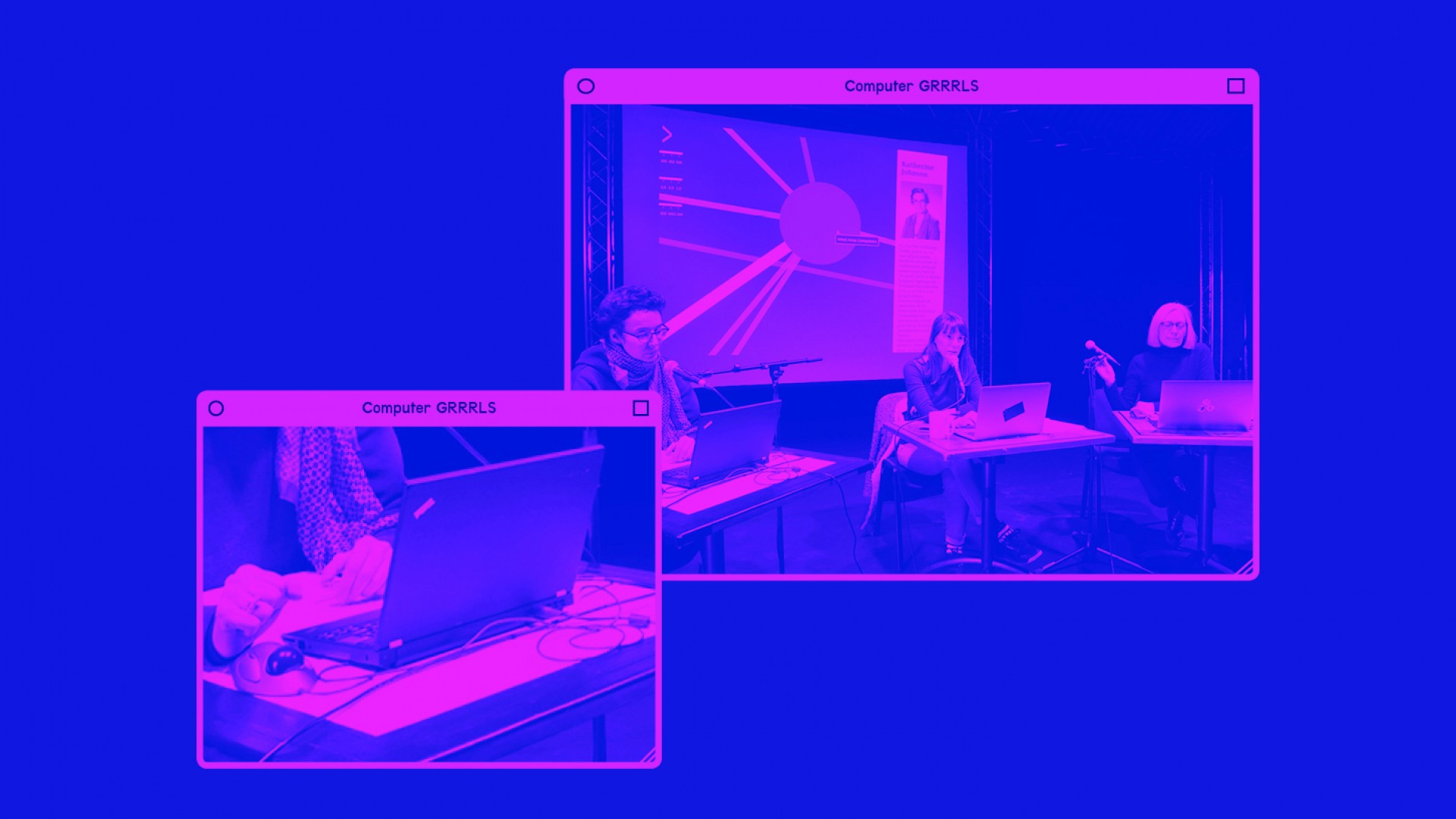

Table ronde : Comment rendre l’I.A. plus inclusive ?

Des logiciels de recrutement automatique qui défavorisent les femmes, des programmes de reconnaissance faciale qui peinent à reconnaître les femmes de couleur, des chatbots qui deviennent racistes et sexistes. Les exemples de biais liées charriés par l’intelligence artificielle (I.A.) - un secteur qui ne compte que 12% de femmes - prolifèrent.

Le déploiement de ces technologies risquent d’amplifier la marginalisation et l’inéquité sociale, comme l’ont observé les chercheuses Safiya U Noble, Marie Hicks ou Cathy O’Neil ou encore Kate Crawford qui dès 2016 relevait que l’I.A. avait un "problème d’homme blanc".

Intervenantes

- Peggy Pierrot : activiste, journaliste et développeuse, elle analyse les liens entre racisme, production d'algorithmes et de données, travail, management et marketing de la diversité dans le secteur technologique.

- Aude Bernheim : généticienne à l’Institut Weizmann et co-fondatrice de Wax Science, elle s’est investie sur le sujet de la mixité dans les sciences. Elle a co-écrit, avec Flora Vincent, L'intelligence artificielle, pas sans elles (Editions Belin, 2019).

- Alice Coucke : senior machine learning scientist pour la start-up Snips. Formée à la physique théorique, elle travaille sur le traitement automatique du langage naturel, pour les assistants vocaux intégrés aux objets connectés du quotidien.

- Modération par Elisa Braun : journaliste en culture et économie numériques, elle travaille au Figaro Tech et plus ponctuellement pour Usbek et Rika et France Culture.

Dans le cadre de l'exposition Computer Grrrls

Vingt-trois artistes et collectifs internationaux livrent un regard critique et incisif sur les technologies numériques. Elles revisitent l’histoire des femmes et des machines et esquissent des scénarios pour un futur plus inclusif.